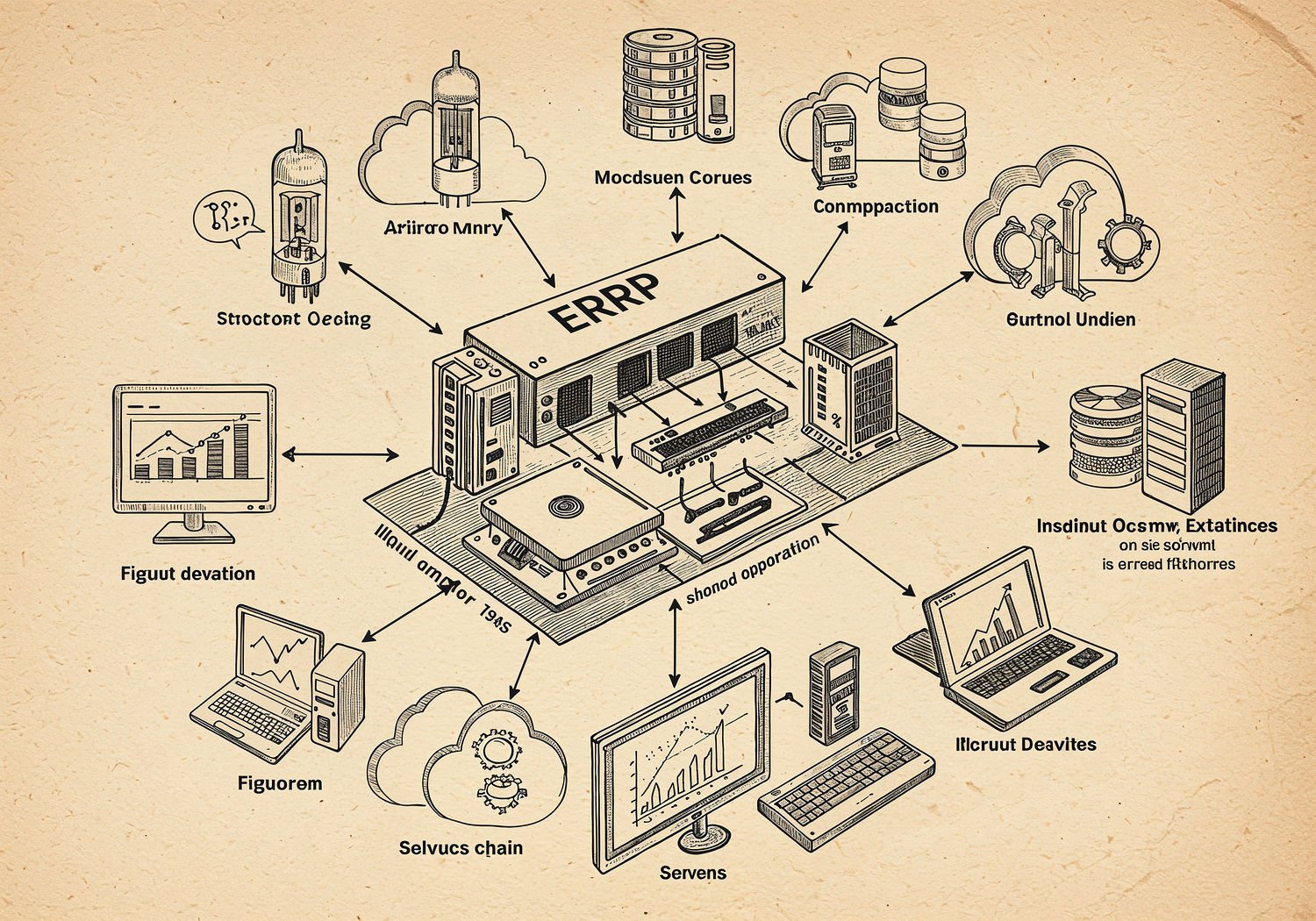

Architektura von Neumanna – fundament przechowywanego programu w systemach ERP

Architektura von Neumanna, opisana w 1945 roku przez wybitnego matematyka Johna von Neumanna, stanowi kamień węgielny współczesnej informatyki. Ten model, w którym program i dane dzielą tę samą pamięć, zrewolucjonizował sposób projektowania komputerów, umożliwiając elastyczne i skalowalne systemy obliczeniowe. W kontekście systemów ERP (Enterprise Resource Planning), ta architektura stała się podstawą dla zintegrowanych platform biznesowych, które zarządzają procesami od księgowości po łańcuchy dostaw. Artykuł ten zgłębia, jak prosty koncept przechowywanego programu ewoluował w narzędzie napędzające globalne przedsiębiorstwa, łącząc teorię z praktyką biznesową.

Geneza modelu – wizja z 1945 roku

W 1945 roku John von Neumann, współpracując z zespołem w Instytucie Badań Zaawansowanych w Princeton, przygotował raport EDVAC (Electronic Discrete Variable Automatic Computer), który położył podwaliny pod nowoczesną architekturę komputerową. Dokument ten, zatytułowany First Draft of a Report on the EDVAC, opisywał model obliczeniowy inspirowany potrzebami II wojny światowej, gdzie szybkie i elastyczne maszyny były kluczowe do symulacji i obliczeń balistycznych.

Von Neumann dostrzegł ograniczenia ówczesnych komputerów, takich jak ENIAC (Electronic Numerical Integrator and Computer), które wymagały fizycznej rekonfiguracji okablowania, by zmienić program. Zamiast tego zaproponował przechowywany program (stored-program concept), gdzie instrukcje programu są traktowane jak dane i przechowywane w tej samej pamięci co zmienne obliczeniowe. To pozwoliło na dynamiczne modyfikowanie oprogramowania bez ingerencji sprzętowej, co było przełomem w erze mechanicznych przełączników i lamp próżniowych.

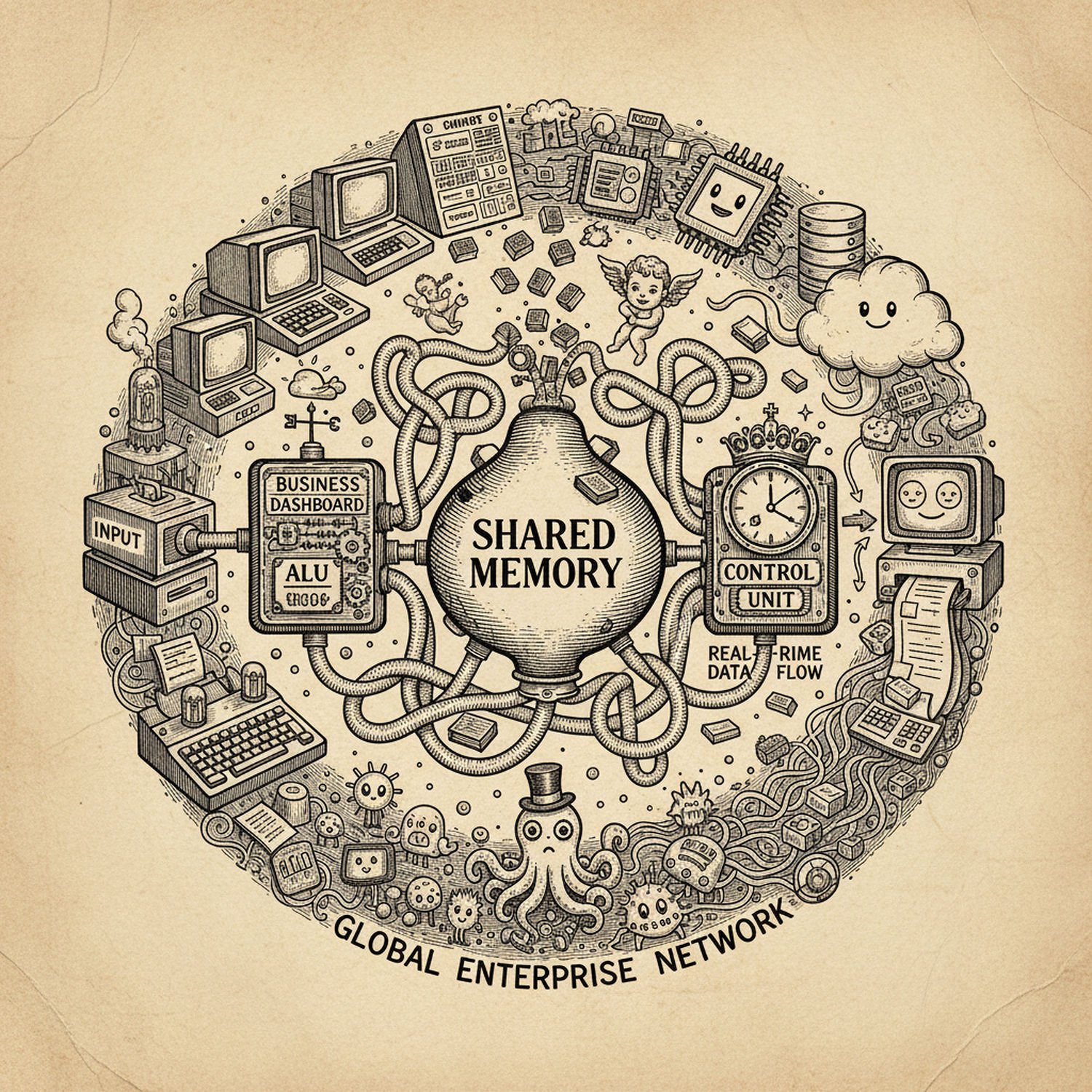

Model von Neumanna składał się z pięciu podstawowych komponentów: jednostki arytmetyczno-logicznej (Arithmetic Logic Unit, ALU), jednostki sterującej (Control Unit), pamięci (Memory), wejścia (Input) i wyjścia (Output). Pamięć była centralnym elementem – uniwersalna, adresowalna sekwencyjnie, co umożliwiało łatwe ładowanie i wykonywanie programów. Ta wizja nie była czystą teorią; wpłynęła bezpośrednio na budowę komputerów jak EDSAC czy IAS machine, przyspieszając rozwój elektroniki cyfrowej.

W kontekście historycznym, architektura ta wyszła naprzeciw potrzebom powojennej rekonstrukcji, gdzie komputery miały wspierać nie tylko wojsko, ale i gospodarkę. Von Neumann przewidywał, że maszyny te staną się narzędziami do przetwarzania ogromnych zbiorów danych, co później znalazło odzwierciedlenie w systemach biznesowych.

Kluczowe cechy architektury – wspólna pamięć i jej implikacje

Sercem architektury von Neumanna jest wspólna pamięć dla programu i danych, co odróżnia ją od starszych modeli, jak maszyny Turinga kompletne, gdzie program był statyczny. W tym podejściu pamięć jest liniowo adresowalna – każdy bajt lub słowo ma unikalny adres, a procesor pobiera instrukcje i dane z tej samej przestrzeni. To umożliwia samo-modyfikujące się programy, gdzie kod może zmieniać samego siebie w trakcie wykonania, co zwiększa elastyczność.

Jednostka sterująca odczytuje instrukcje z pamięci, dekoduje je i kieruje ALU do wykonywania operacji arytmetycznych lub logicznych. Cykl von Neumanna – fetch-decode-execute – definiuje podstawowy rytm pracy procesora: pobranie instrukcji, jej interpretacja i realizacja. Ta sekwencyjna natura, choć prosta, pozwoliła na skalowanie od prostych kalkulatorów do superkomputerów.

Jednak architektura ta ma swoje ograniczenia, znane jako butelka szyjna von Neumanna (von Neumann bottleneck). Wspólna szyna pamięciowa powoduje, że przepustowość jest ograniczona – procesor musi czekać na dostęp do pamięci, co spowalnia systemy przy dużych obciążeniach. Mimo to, ten model dominuje do dziś, ewoluując w architektury z pamięcią podręczną (cache) i wielordzeniowymi procesorami, by złagodzić te problemy.

W aspekcie teoretycznym, architektura von Neumanna formalizuje ideę uniwersalnej maszyny obliczeniowej, zgodną z modelem Alana Turinga. Umożliwia ona realizację dowolnego algorytmu poprzez zapisany program, co jest fundamentem programowania imperatywnego. Bez tej koncepcji, współczesne systemy oprogramowania byłyby nie do wyobrażenia – od edytorów tekstu po złożone symulacje.

Rewolucja w projektowaniu komputerów – od lamp do mikroprocesorów

Adopcja architektury von Neumanna przyspieszyła ewolucję komputerów w latach 50. i 60. XX wieku. Pierwsze komercyjne maszyny, jak IBM 701, opierały się na tym modelu, przechodząc od magnetycznych bębnów do rdzeni ferrytowych jako nośników pamięci. To pozwoliło na rozwój języków programowania wysokiego poziomu, takich jak FORTRAN, gdzie programiści pisali w abstrakcyjnym kodzie, kompilowanym do binarnych instrukcji przechowywanych w pamięci.

W erze tranzystorów i układów scalonych, architektura ta stała się standardem dla mikroprocesorów. Intel 4004 z 1971 roku, pierwszy komercyjny mikroukład, implementował von Neumannowski model w miniaturowej skali, umożliwiając personalne komputery. Dziś, w erze chmur obliczeniowych i AI, nadal dominuje – procesory ARM czy x86 to jej warianty, zoptymalizowane pod kątem współbieżności i wirtualizacji.

Wpływ na branżę jest nieoceniony: umożliwiła masową produkcję sprzętu, obniżając koszty i democratatyzując dostęp do mocy obliczeniowej. Bez przechowywanego programu, komputery pozostałyby specjalistycznymi maszynami, a nie uniwersalnymi narzędziami.

Zastosowanie w systemach ERP – integracja biznesu z obliczeniami

Systemy ERP, takie jak SAP czy Oracle, to bezpośredni potomkowie rewolucji von Neumanna, wykorzystując przechowywany program do zarządzania zintegrowanymi procesami biznesowymi. ERP integrują moduły księgowości, HR, logistyki i łańcuchów dostaw w jedną platformę, gdzie dane i algorytmy współdzielą bazę danych – analogicznie do wspólnej pamięci.

W ERP, architektura von Neumanna manifestuje się w warstwie aplikacyjnej: programy biznesowe (np. moduł finansowy) są przechowywane w pamięci serwera, przetwarzając dane transakcyjne w czasie rzeczywistym. Na przykład, w module SCM (Supply Chain Management), algorytmy optymalizacyjne – oparte na liniowym programowaniu – analizują zapasy i prognozy, modyfikując się dynamicznie pod wpływem nowych danych wejściowych. To umożliwia automatyzację, jak w systemach MRP (Material Requirements Planning), gdzie program oblicza potrzeby materiałowe na podstawie zamówień.

Rozwój ERP w latach 90., z nadejściem klienta-serwer i baz danych relacyjnych (np. SQL), czerpał z von Neumannowskiego paradygmatu. Wspólna pamięć ewoluowała w scentralizowane bazy, gdzie transakcje ACID (Atomicity, Consistency, Isolation, Durability) zapewniają spójność. W chmurze, jak AWS czy Azure, ERP korzysta z wirtualnych maszyn implementujących ten model, skalując zasoby dynamicznie.

Bez tej architektury, zintegrowane systemy biznesowe byłyby rozdrobnione – każdy moduł wymagałby osobnego sprzętu. Dziś ERP obsługują globalne korporacje, przetwarzając petabajty danych, od prognozowania popytu po compliance regulacyjne. Przykładowo, w przemyśle motoryzacyjnym, systemy jak SAP S/4HANA używają wbudowanych algorytmów machine learning, przechowywanych i wykonywanych w pamięci, by optymalizować łańcuchy dostaw w czasie pandemii czy kryzysów.

Przyszłość architektury – wyzwania i ewolucja w ERP

Mimo wieku, architektura von Neumanna adaptuje się do nowych wyzwań. W ERP, rosnące dane big data i IoT (Internet of Things) wymagają hybrydowych modeli, jak neuromorficzne procesory, które łagodzą butelkę szyjną poprzez równoległe przetwarzanie. Neuromorfika, inspirowana mózgiem, przechowuje program i dane w rozproszonej pamięci, ale nadal opiera się na von Neumannowskich zasadach.

W kontekście ERP, przyszłość to edge computing, gdzie moduły IoT w łańcuchach dostaw wykonują lokalne obliczenia, synchronizując z centralnym systemem. To rozszerza przechowywany program na rozproszone środowiska, z blockchainem zapewniającym bezpieczeństwo transakcji.

Podsumowując, wizja von Neumanna z 1945 roku nie tylko zdefiniowała komputery, ale i ukształtowała ERP jako rdzeń cyfrowej transformacji biznesu. Od prostego raportu do miliardowych wdrożeń – ten model przypomina, jak fundamentalne idee napędzają złożone ekosystemy.

Informacja: Artykuł (w szczególności treści i obrazy) powstał w całości lub w części przy udziale sztucznej inteligencji (AI). Niektóre informacje mogą być niepełne lub nieścisłe oraz zawierać błędy i/lub przekłamania. Publikowane treści mają charakter wyłącznie informacyjny i nie stanowią porady w szczególności porady prawnej, medycznej ani finansowej. Artykuły sponsorowane i gościnne są przygotowywane przez zewnętrznych autorów i partnerów. Redakcja nie ponosi odpowiedzialności za aktualność, poprawność ani skutki zastosowania się do przedstawionych informacji. W przypadku decyzji dotyczących zdrowia, prawa lub finansów należy skonsultować się z odpowiednim specjalistą.

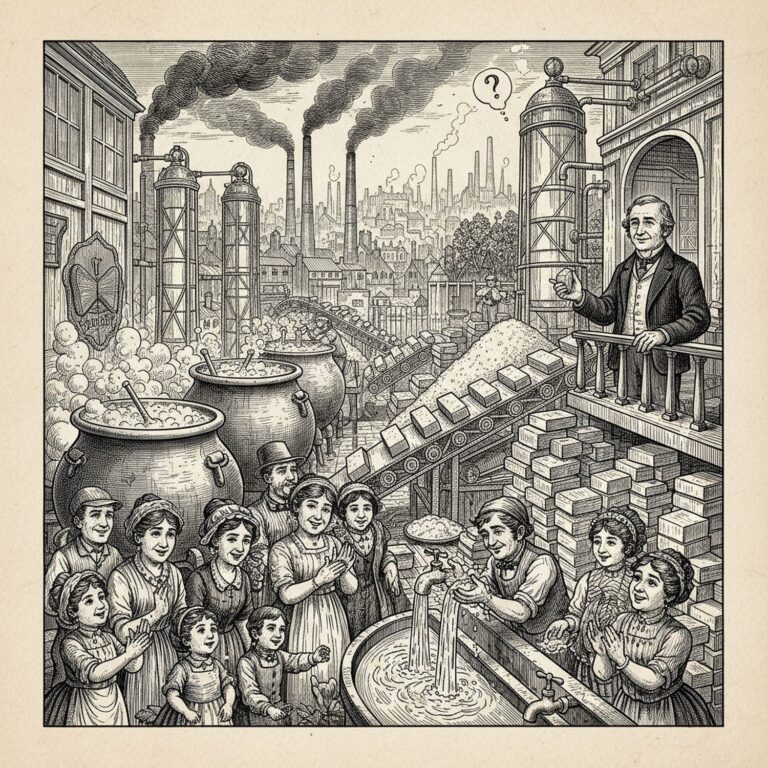

Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: A central schematic diagram of the Von Neumann architecture featuring a shared memory unit holding both program instructions and data, connected via buses to the Arithmetic Logic Unit (ALU) performing calculations, the Control Unit directing operations, Input devices like keyboards and sensors, and Output devices such as screens and printers. Surrounding the diagram, icons of evolving technology from vacuum tubes and early computers in 1945 to modern microprocessors and cloud servers, with ERP elements integrated: a business dashboard showing interconnected modules for finance, HR, supply chain, and logistics, data flowing between them in real-time, and futuristic extensions like IoT devices and edge computing nodes linking to a global enterprise network. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist.

Polecamy: Technologie IT – od liczydła do komputerów