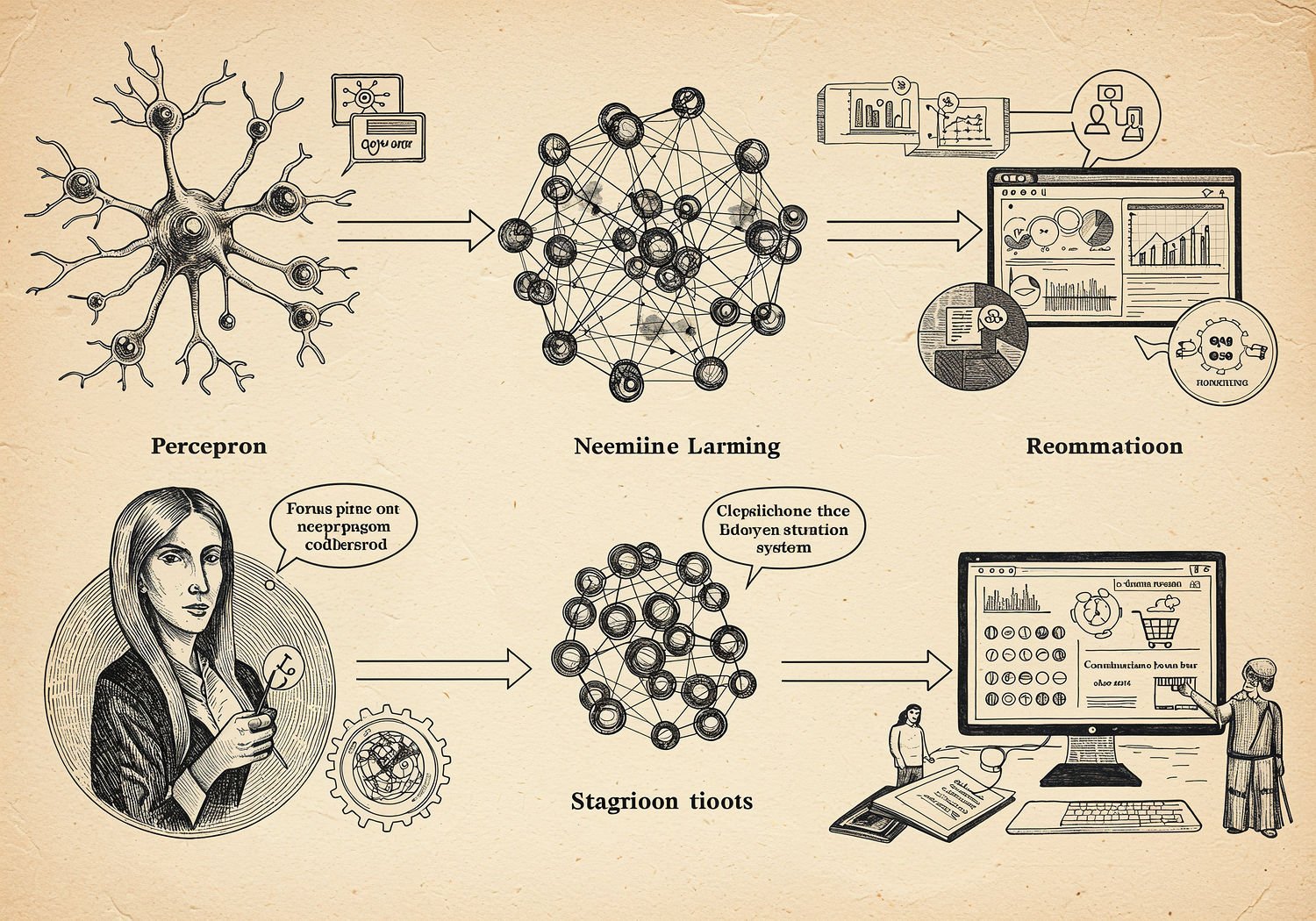

Machine learning – od perceptronów do algorytmów rekomendacyjnych w e-commerce

Uczenie maszynowe, znane jako machine learning (ML), stało się fundamentem nowoczesnego biznesu, szczególnie w sektorze e-commerce. Od prostych modeli inspirowanych biologią po zaawansowane systemy oparte na głębokim uczeniu, ta dziedzina ewoluowała w sposób, który pozwala firmom personalizować doświadczenia klientów i zwiększać zyski. W tym artykule przyjrzymy się drodze ML od jego początków w postaci perceptronów aż po praktyczne zastosowania w rekomendacjach zakupowych, takich jak te na platformie Amazon. Dowiemy się, jak historyczne dane napędzają te algorytmy, prowadząc do wzrostu konwersji nawet o 35%, oraz jak inwestycje w personalizację przynoszą wymierny zwrot z inwestycji (ROI).

Początki uczenia maszynowego – perceptron jako pierwszy krok

Początki uczenia maszynowego sięgają lat 50. XX wieku, kiedy to psycholog i informatyk Frank Rosenblatt zaproponował koncepcję perceptron. Był to prosty model inspirowany działaniem neuronów w mózgu ludzkim, mający na celu klasyfikację binarnych danych wejściowych. Perceptron działał na zasadzie sumowania ważonych sygnałów wejściowych i porównywania ich z progiem aktywacji – jeśli suma przekraczała próg, neuron “strzelał” sygnałem, inaczej pozostawał bierna.

W praktyce perceptron uczył się poprzez dostosowywanie wag połączeń między wejściami a wyjściem, wykorzystując algorytm oparty na różnicy między przewidywanym a rzeczywistym wynikiem, czyli błąd. Ta metoda, znana jako uczenie nadzorowane (supervised learning), pozwalała modelowi poprawiać się iteracyjnie na zbiorach danych z etykietami. Na przykład, w wczesnych aplikacjach perceptron mógł rozpoznawać proste wzorce, takie jak litery na obrazie, dzieląc je na kategorie “A” lub “nie A”.

Mimo swojej prostoty, perceptron napotkał ograniczenia. W 1969 roku Marvin Minsky i Seymour Papert w książce Perceptrons pokazali, że model ten nie radzi sobie z nieliniowo separowalnymi danymi, co zahamowało rozwój badań nad sieciami neuronowymi na prawie dekadę. Niemniej jednak, perceptron położył podwaliny pod całą dziedzinę ML, demonstrując, jak maszyny mogą “uczyć się” z danych bez sztywno zaprogramowanych reguł. Dziś, choć proste modele jak regresja liniowa czy drzewa decyzyjne ewoluowały z tych idei, perceptron pozostaje symbolem początków automatyzacji uczenia.

Ta ewolucja pokazuje, jak ML przeszło od abstrakcyjnych koncepcji do narzędzi biznesowych. Wczesne modele, choć ograniczone, nauczyły badaczy skupiać się na jakości danych i optymalizacji parametrów, co jest kluczowe w dzisiejszych aplikacjach e-commerce.

Ewolucja modeli – od prostych algorytmów do sieci neuronowych

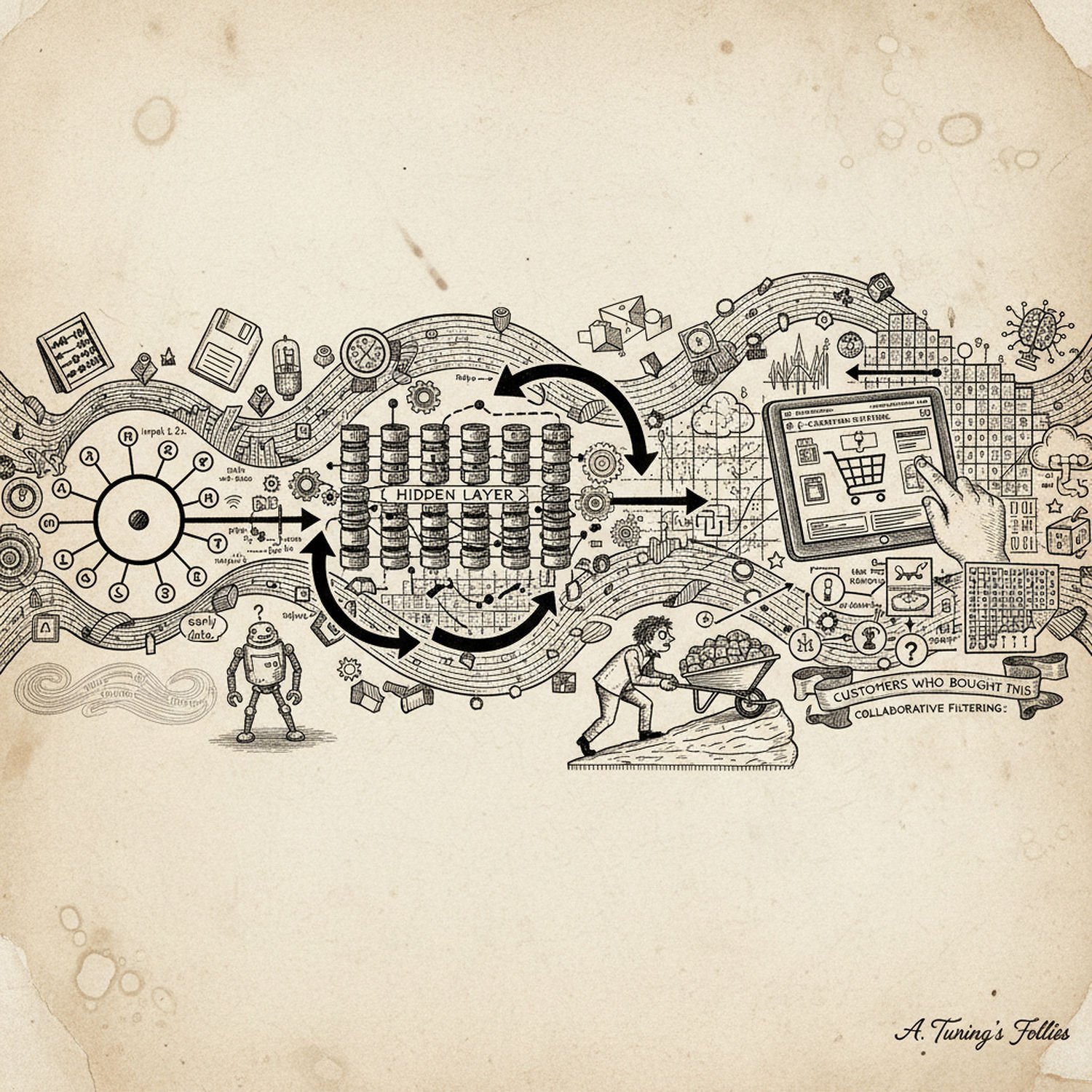

Z lat 80. i 90. XX wieku pamiętamy rozwój bardziej zaawansowanych technik, które pokonały ograniczenia perceptronów. Kluczowym krokiem było wprowadzenie wielowarstwowych sieci neuronowych (multi-layer perceptrons, MLP), umożliwiających modelowanie nieliniowych zależności dzięki warstwom ukrytym. Algorytm backpropagation, opracowany przez Rumelharata i in. w 1986 roku, pozwolił na efektywne trenowanie tych sieci poprzez propagację błędu wstecz i dostosowywanie wag.

W tym okresie zyskały popularność algorytmy uczenia nienadzorowanego (unsupervised learning), takie jak k-means clustering, które grupują dane bez etykiet, oraz metody ensemble, jak lasy losowe (random forests), łączące wiele drzew decyzyjnych dla lepszej dokładności. Te narzędzia stały się podstawą dla biznesu, gdzie dane klientów – zakupy, kliknięcia, preferencje – musiały być analizowane bez pełnej etykietyzacji.

Przejście do ery big data w latach 2000. przyniosło eksplozję zastosowań ML. Algorytmy rekomendacyjne, oparte na filtracji kolaboracyjnej (collaborative filtering), analizowały podobieństwa między użytkownikami lub przedmiotami. Na przykład, metoda user-based collaborative filtering sugeruje produkty na podstawie tego, co kupili podobni klienci. Z kolei item-based filtering skupia się na podobieństwach między produktami, co jest szybsze obliczeniowo.

Ta ewolucja nie byłaby możliwa bez wzrostu mocy obliczeniowej i dostępności danych. Firmy zaczęły gromadzić ogromne zbiory historycznych interakcji, co pozwoliło na trenowanie modeli predykcyjnych. W e-commerce proste modele regresji logistycznej ewoluowały w kierunku hybrydowych systemów, integrujących treści (content-based filtering) z zachowaniami użytkowników, zwiększając precyzję rekomendacji.

Algorytmy rekomendacyjne w e-commerce – personalizacja oparta na danych

W świecie e-commerce algorytmy rekomendacyjne to serce machine learning, transformujące anonimowe zakupy w spersonalizowane doświadczenia. Te systemy opierają się na historycznych danych – zapisach kliknięć, koszyków, ocen i czasu spędzonego na stronie – by przewidywać, co klient kupi dalej. Podstawowy mechanizm to macierz użytkownik-przedmiot (user-item matrix), gdzie brakujące wartości są uzupełniane przez modele ML, takie jak matrix factorization (np. SVD – singular value decomposition).

W praktyce, algorytmy te dzielą się na kategorie. Filtracja kolaboracyjna zakłada, że użytkownicy o podobnych gustach polubią te same produkty. Na przykład, jeśli Anna i Beata obie kupiły książki o gotowaniu, system zasugeruje Annie przepisnik, który podobał się Beacie. Z kolei filtracja treściowa analizuje cechy produktów – gatunek, cenę, markę – by polecać podobne przedmioty na podstawie przeszłych wyborów użytkownika.

Hybrydowe podejścia, łączące obie metody, dominują w dużych platformach. Dodatkowe techniki, jak deep learning z sieciami neuronowymi grafowymi (graph neural networks, GNN), modelują relacje między użytkownikami i produktami jako graf, co pozwala na dynamiczne rekomendacje w czasie rzeczywistym. W e-commerce to oznacza sugestie “kupione przez klientów, którzy kupili to” lub “często kupowane razem”, zwiększając średnią wartość koszyka.

Korzyści biznesowe są ogromne. Według badań, personalizowane rekomendacje mogą podnieść konwersje – stosunek odwiedzin do zakupów – nawet o 35%. To nie magia, lecz rezultat analizy miliardów interakcji. Firmy jak Netflix czy Spotify udowodniły, że ML redukuje churn (utratę klientów) o 20-30%, a w e-commerce skraca ścieżkę decyzyjną, minimalizując porzucanie koszyków.

Praktyka Amazona – sugestie oparte na ML i ich wpływ na biznes

Amazon to ikona zastosowania machine learning w e-commerce, gdzie algorytmy rekomendacyjne generują do 35% przychodów. System Amazona, ewoluujący od prostych reguł w latach 90., dziś opiera się na zaawansowanym Amazon Personalize – usłudze chmurowej wykorzystującej ML do tworzenia modeli na żądanie.

Kluczowy element to analiza historycznych danych: każdy klik, wyszukiwanie i zakup jest rejestrowany w Amazon S3 i przetwarzany przez frameworki jak Apache Spark z bibliotekami MLlib. Algorytmy, takie jak factorization machines czy głębokie sieci neuronowe, uczą się wzorców sezonowych, kontekstu (np. urządzenie użytkownika) i długoterminowych preferencji. Na przykład, sugestia “Klienci, którzy kupili ten produkt, kupili również…” bazuje na item-to-item collaborative filtering, opracowanym przez Amazona w 2003 roku, co zwiększyło sprzedaż o 13% w tamtym okresie.

Efekt? Wzrost konwersji o 35%, jak podają raporty wewnętrzne i studia przypadków. To przekłada się na miliardy dolarów oszczędności i zysków. Amazon nie tylko rekomenduje, ale też optymalizuje ceny i inwentarz za pomocą ML, przewidując popyt z modelem prophet (biblioteka Facebooka) czy sieci LSTM do szeregów czasowych.

Ta implementacja pokazuje ROI personalizacji: inwestycja w infrastrukturę ML zwraca się poprzez wyższą lojalność klientów i efektywność operacyjną. Firmy naśladują Amazon, integrując ML z CRM, co skraca czas od danych do decyzji.

Deep learning w personalizacji – przyszłość ML w biznesie i ROI

Przejście do deep learning (DL) to rewolucja w ML, umożliwiająca obsługę nieustrukturyzowanych danych, jak obrazy czy tekst. W e-commerce DL napędza zaawansowaną personalizację, np. poprzez convolutional neural networks (CNN) do analizy zdjęć produktów lub recurrent neural networks (RNN) do sekwencyjnych rekomendacji, jak w sesjach przeglądania.

Ewolucja od perceptronów do DL pokazuje, jak modele stały się głębsze – setki warstw w architekturach jak transformers (podstawa GPT) – przetwarzając miliardy parametrów. W biznesie to oznacza ROI na poziomie 5-10x dla inwestycji w DL. Na przykład, personalizacja wizualna (rekomendacje na podstawie zdjęć) zwiększa klikalność o 20%, a analiza sentymentu recenzji pomaga w moderacji treści.

Przyszłość to federated learning (uczenie rozproszone), chroniące prywatność danych, i edge computing, gdzie modele działają na urządzeniach użytkownika. Dla e-commerce oznacza to hiperpersonalizację – sugestie dostosowane do nastroju czy lokalizacji – podnosząc konwersje dalej. Firmy inwestujące w DL raportują ROI powyżej 200% w ciągu 2-3 lat, dzięki skalowalności i adaptacyjności.

Podsumowując, od perceptronów do DL, machine learning przekształciło e-commerce w ekosystem oparty na danych, gdzie personalizacja nie jest luksusem, lecz koniecznością biznesową. Inwestycje w te technologie nie tylko zwiększają zyski, ale budują długoterminową przewagę konkurencyjną.

Informacja: Artykuł (w szczególności treści i obrazy) powstał w całości lub w części przy udziale sztucznej inteligencji (AI). Niektóre informacje mogą być niepełne lub nieścisłe oraz zawierać błędy i/lub przekłamania. Publikowane treści mają charakter wyłącznie informacyjny i nie stanowią porady w szczególności porady prawnej, medycznej ani finansowej. Artykuły sponsorowane i gościnne są przygotowywane przez zewnętrznych autorów i partnerów. Redakcja nie ponosi odpowiedzialności za aktualność, poprawność ani skutki zastosowania się do przedstawionych informacji. W przypadku decyzji dotyczących zdrowia, prawa lub finansów należy skonsultować się z odpowiednim specjalistą.

Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: A timeline illustration showing the evolution of machine learning: on the left, a simple perceptron neuron with input signals and weights connecting to an output; in the middle, a multi-layer neural network with hidden layers and backpropagation arrows; on the right, an e-commerce recommendation system depicting users browsing products on a screen, with collaborative filtering lines connecting similar users and items, data matrices filling in predictions, and Amazon-style suggestions like „customers who bought this also bought” appearing below a shopping cart; background elements include historical data streams flowing from past purchases to future predictions, with icons of increasing complexity from binary classifications to deep learning graphs. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist.

Polecamy: Technologie IT – od liczydła do komputerów