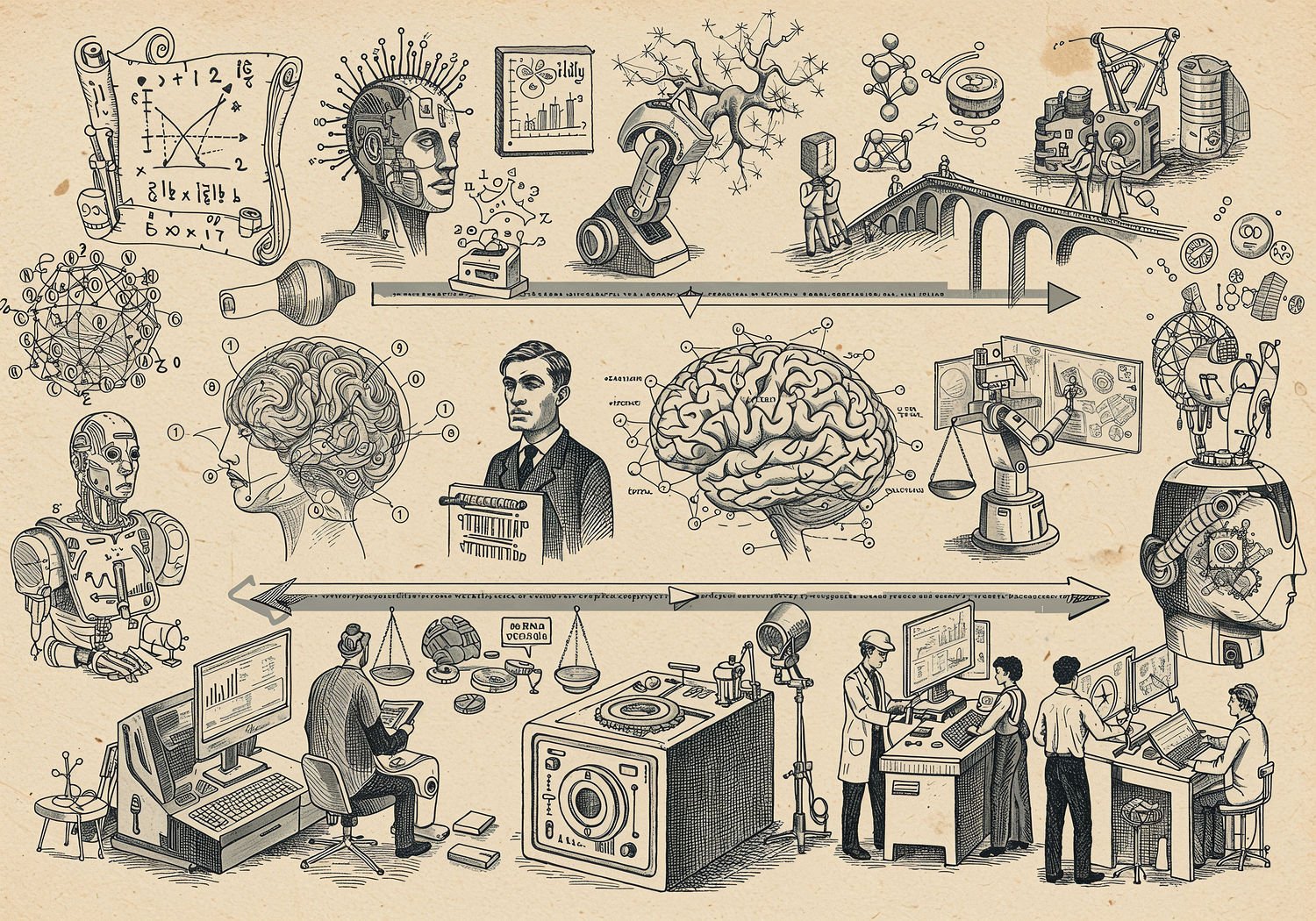

Sztuczna inteligencja – od matematycznych korzeni do rewolucji w nauce i pracy

Sztuczna inteligencja, często skracana do AI, stała się jednym z najbardziej przełomowych osiągnięć współczesnej nauki. Od abstrakcyjnych idei matematycznych po zaawansowane algorytmy, które symulują ludzkie myślenie, AI nie tylko zmienia sposób, w jaki prowadzimy badania, ale także rewolucjonizuje rynek pracy. W tym artykule z cyklu “Przełomowe odkrycia w historii nauki” prześledzimy jej rozwój, zaczynając od fundamentalnych podstaw, przez wizjonerskie prace Alana Turinga, aż po nowoczesne sieci neuronowe. Omówimy też, jak AI wpływa na odkrywanie nowych leków i inne dziedziny nauki, pokazując, dlaczego to odkrycie jest kluczowe dla przyszłości ludzkości.

Matematyczne fundamenty – korzenie AI w logice i probabilistyce

Podstawy sztucznej inteligencji wywodzą się z matematyki, która od wieków stanowi filar nauk ścisłych. Już w XIX wieku, George Boole, angielski matematyk, opracował algebrę boolowską, system logiki binarnej oparty na wartościach zero i jeden. To właśnie ta algebra stała się podstawą cyfrowych komputerów, umożliwiając przetwarzanie informacji w sposób mechaniczny. Bez niej nie byłoby możliwe budowanie algorytmów, które symulują decyzje.

W XX wieku, rozwój probabilistyki i statystyki dodał kolejny wymiar. Ronald Fisher i inni statystycy wprowadzili metody, takie jak regresja liniowa, które pozwalają modelować niepewności w danych. Te narzędzia matematyczne stały się kluczowe dla uczenia maszynowego, gałęzi AI, gdzie systemy uczą się na podstawie wzorców w danych, a nie sztywnych reguł. Na przykład, w prostym algorytmie klasyfikacji, matematyka probabilistyczna pomaga przewidzieć, czy dany e-mail to spam, obliczając prawdopodobieństwo na podstawie cech tekstu.

Te matematyczne korzenie nie były przypadkowe. W latach 40. i 50. XX wieku, wraz z rozwojem komputerów elektronicznych, matematycy i logicy zaczęli zadawać pytanie: czy maszyna może myśleć? To pytanie popchnęło naukę ku AI, czyniąc z matematyki nie tylko narzędzie, ale fundament całej dyscypliny.

Alan Turing i narodziny idei maszyn myślących – punkt zwrotny w historii

Alan Turing, brytyjski matematyk i kryptolog, jest uważany za ojca sztucznej inteligencji. W 1936 roku opublikował artykuł “On computable numbers”, w którym opisał hipotetyczną maszynę, nazwaną maszyną Turinga. To abstrakcyjne urządzenie mogło symulować dowolny algorytm, stając się modelem dla wszystkich przyszłych komputerów. Turing udowodnił, że istnieją problemy nierozwiązywalne przez maszyny, co otworzyło debatę o granicach inteligencji maszynowej.

Po II wojnie światowej, w 1950 roku, Turing napisał przełomowy esej “Computing machinery and intelligence”, gdzie postawił słynne pytanie: “Czy maszyny mogą myśleć?”. Zaproponował test Turinga, prosty eksperyment, w którym człowiek rozmawia z ukrytym rozmówcą – człowiekiem lub maszyną – i próbuje odgadnąć, kto jest kim. Jeśli maszyna oszuka eksperta, uznaje się ją za inteligentną. Ten test nie tylko zainspirował filozofów, ale też stał się benchmarkiem dla wczesnych programów AI.

Wpływ Turinga wykraczał poza teorię. W latach 50. jego prace przyczyniły się do powstania pierwszych komputerów zdolnych do prostych obliczeń, takich jak rozwiązanie problemów szachowych. Turing popełnił samobójstwo w 1954 roku, ale jego dziedzictwo przetrwało, inspirując pokolenia naukowców do eksploracji granic między człowiekiem a maszyną.

Ewolucja algorytmów – od prostych sieci neuronowych do głębokiego uczenia

Rozwój AI przyspieszył w drugiej połowie XX wieku, gdy algorytmy zaczęły naśladować biologiczne procesy mózgu. W 1943 roku Warren McCulloch i Walter Pitts zaproponowali model sztucznych neuronów, inspirowany neuronami ludzkiego mózgu. Każdy neuron to prosta jednostka matematyczna, która odbiera sygnały, przetwarza je i przekazuje dalej, jeśli przekroczą próg aktywacji.

W latach 50. Frank Rosenblatt zbudował perceptron, pierwszy sprzętowy model sieci neuronowej, zdolny do uczenia się prostych wzorców, jak rozpoznawanie kształtów. Jednak w 1969 roku Marvin Minsky i Seymour Papert w książce “Perceptrons” wskazali na ograniczenia tych modeli, co doprowadziło do “ai zimy” – okresu spadku finansowania badań.

Odrodzenie nastąpiło w latach 80. i 90., dzięki algorytmom backpropagation, które pozwalają sieciom neuronowym korygować błędy podczas uczenia. W XXI wieku, z rozwojem mocy obliczeniowej i big data, powstało głębokie uczenie (deep learning). To zaawansowane sieci neuronowe z wieloma warstwami, jak konwolucyjne sieci neuronowe (CNN) do obrazowania czy rekurencyjne sieci neuronowe (RNN) do przetwarzania sekwencji, np. mowy.

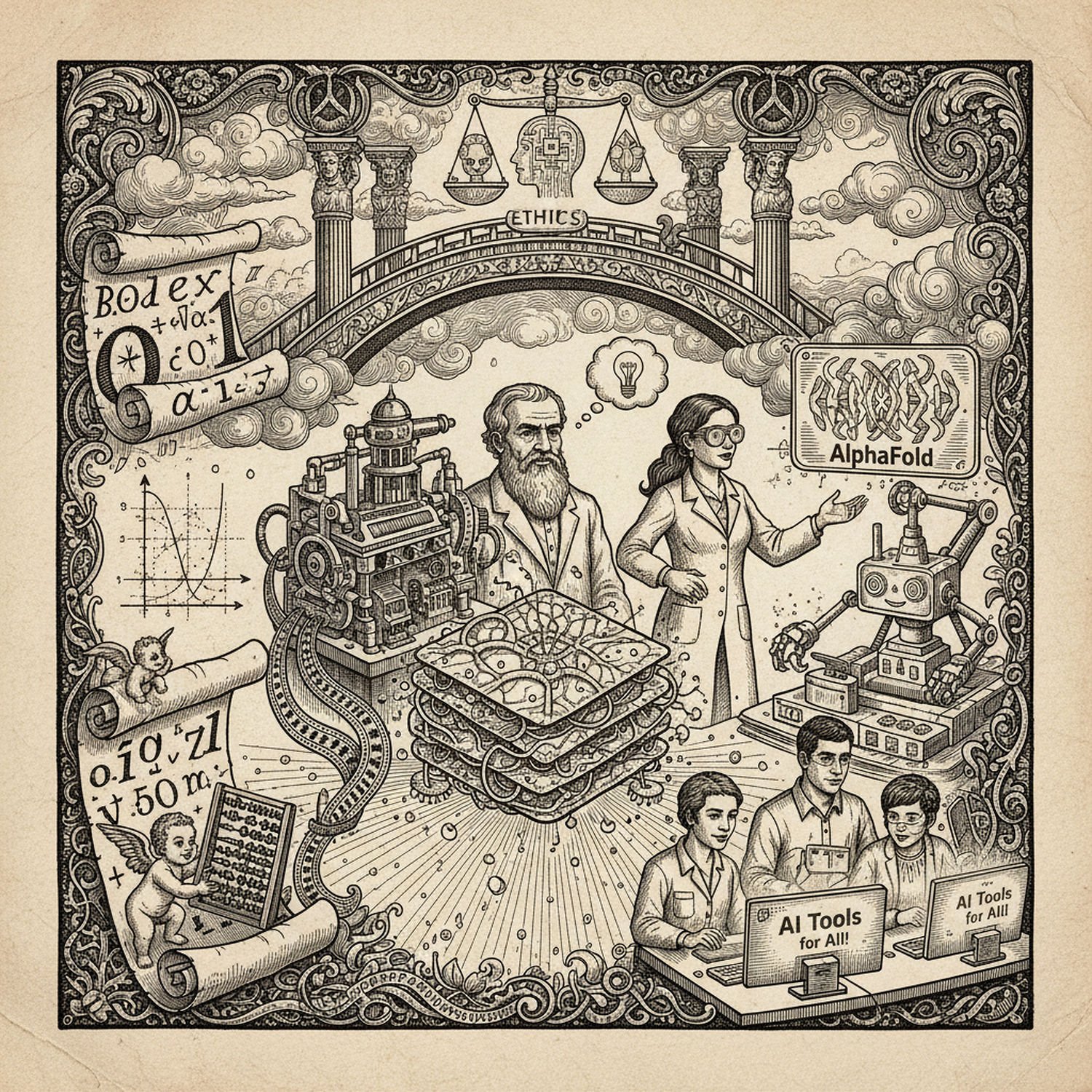

Dziś, modele takie jak GPT czy AlphaFold, oparte na głębokim uczeniu, przetwarzają miliardy parametrów. AlphaFold, stworzony przez DeepMind, przewiduje struktury białek z niespotykaną dokładnością, co rewolucjonizuje biologię. Ewolucja ta pokazuje, jak AI przeszła od prostych kalkulacji do systemów, które uczą się autonomicznie, zmieniając oblicze nauki.

Wpływ AI na badania naukowe – odkrywanie leków i nowe horyzonty

Sztuczna inteligencja nie jest już tylko narzędziem – staje się współtwórcą odkryć naukowych. W farmakologii, gdzie tradycyjne testy leków trwają lata i kosztują miliardy, AI skraca ten proces. Na przykład, w 2020 roku AlphaFold rozwiązał problem składania białek, który dręczył naukowców od dekad. Dzięki temu, badacze mogą symulować interakcje molekularne, przyspieszając projektowanie nowych leków na choroby jak rak czy Alzheimer.

W medycynie, algorytmy głębokiego uczenia analizują skany MRI czy genomy, wykrywając anomalie z precyzją przewyższającą ludzkich ekspertów. Projekt IBM Watson Health używa AI do personalizacji terapii, przetwarzając dane z milionów pacjentów. W fizyce, AI pomaga w analizie danych z Wielkiego Zderzacza Hadronów, identyfikując cząstki elementarne szybciej niż metody manualne.

Wpływ na inne dziedziny jest równie głęboki. W klimatologii, modele AI prognozują zmiany pogodowe z większą dokładnością, symulując złożone systemy atmosferyczne. W astronomii, teleskopy jak James Webb korzystają z AI do filtrowania danych z miliardów pikseli, odkrywając nowe egzoplanety. Te przykłady pokazują, jak AI nie zastępuje naukowców, ale amplifikuje ich możliwości, umożliwiając badania na skalę wcześniej nieosiągalną.

Zmiany na rynku pracy – szanse i wyzwania wywołane przez AI

Sztuczna inteligencja rewolucjonizuje nie tylko naukę, ale też rynek pracy, tworząc nowe zawody i automatyzując rutynowe zadania. W sektorze produkcyjnym, roboty z AI, jak te w fabrykach Tesli, zwiększają efektywność, ale eliminują proste prace manualne. Według raportów OECD, do 2030 roku AI może zautomatyzować 14% miejsc pracy w krajach rozwiniętych, szczególnie w administracji i transporcie.

Jednak AI otwiera drzwi do nowych ról. Specjaliści od uczenia maszynowego, etycy AI czy inżynierowie danych stają się poszukiwani. W edukacji, platformy jak Duolingo czy Khan Academy używają AI do personalizowanego nauczania, dostosowując treści do potrzeb ucznia. Na rynku pracy, firmy jak Google czy Amazon inwestują w szkolenia, by pracownicy adaptowali się do zmian.

Wyzwania są poważne: nierówności społeczne mogą wzrosnąć, jeśli dostęp do AI będzie ograniczony. Rządy i organizacje, jak Unia Europejska z regulacjami AI Act, pracują nad etycznymi ramami, by zapewnić, że technologia służy wszystkim. W efekcie, AI nie niszczy pracy, ale ją transformuje, wymagając od nas ciągłego uczenia się i adaptacji.

Sztuczna inteligencja, od wizji Turinga po dzisiejsze cuda głębokiego uczenia, to nie tylko przełom w nauce – to katalizator zmian w całym świecie. Jej naukowe korzenie przypominają nam, że największe odkrycia rodzą się z matematyki i ciekawości, a jej wpływ na badania i pracę obiecuje erę innowacji, pod warunkiem mądrego zarządzania. W cyklu “Przełomowe odkrycia w historii nauki” to historia o potencjale, który dopiero zaczyna się rozwijać.

Informacja: Artykuł (w szczególności treści i obrazy) powstał w całości lub w części przy udziale sztucznej inteligencji (AI). Niektóre informacje mogą być niepełne lub nieścisłe oraz zawierać błędy i/lub przekłamania. Publikowane treści mają charakter wyłącznie informacyjny i nie stanowią porady w szczególności porady prawnej, medycznej ani finansowej. Artykuły sponsorowane i gościnne są przygotowywane przez zewnętrznych autorów i partnerów. Redakcja nie ponosi odpowiedzialności za aktualność, poprawność ani skutki zastosowania się do przedstawionych informacji. W przypadku decyzji dotyczących zdrowia, prawa lub finansów należy skonsultować się z odpowiednim specjalistą.

Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: A dynamic timeline illustration depicting the evolution of artificial intelligence: on the left, mathematical roots with Boolean algebra symbols (0s and 1s) and probability graphs emerging from ancient scrolls; in the center, Alan Turing standing beside a conceptual Turing machine with gears and code tapes, transitioning to layered neural networks resembling a human brain with glowing connections; on the right, modern AI applications showing a scientist using AlphaFold to model protein structures on a screen, alongside a factory robot assembling parts and a diverse group of workers learning AI tools on computers; overarching the scene, a bridge connecting human figures to futuristic AI elements like data clouds and ethical scales, symbolizing transformation in science and work. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist.

Polecamy: Nauka i Edukacja