Ewolucja ochrony IT – od klasycznych firewalli do modelu zero-trust w świecie chmury

W dzisiejszym świecie cyfrowym, gdzie dane przepływają przez sieci jak rzeka, ochrona infrastruktury IT staje się nie tylko wyzwaniem technicznym, ale i strategicznym imperatywem. Od prostych barier sieciowych wynalezionych w latach 80. XX wieku po zaawansowane, ciągłe weryfikacje w modelu zero-trust, metody zabezpieczeń ewoluowały, by sprostać rosnącej liczbie zagrożeń. W erze chmurowej, gdzie praca zdalna i hybrydowe środowiska stały się normą, te rozwiązania nie tylko blokują ataki, ale także minimalizują ryzyko naruszeń, chroniąc reputację firm i ich stabilność finansową. Artykuł ten zgłębia tę fascynującą podróż, pokazując, jak firewall z 1988 roku stał się fundamentem dla współczesnych strategii bezpieczeństwa.

Początki firewalli – bariera na straży sieci od 1988 roku

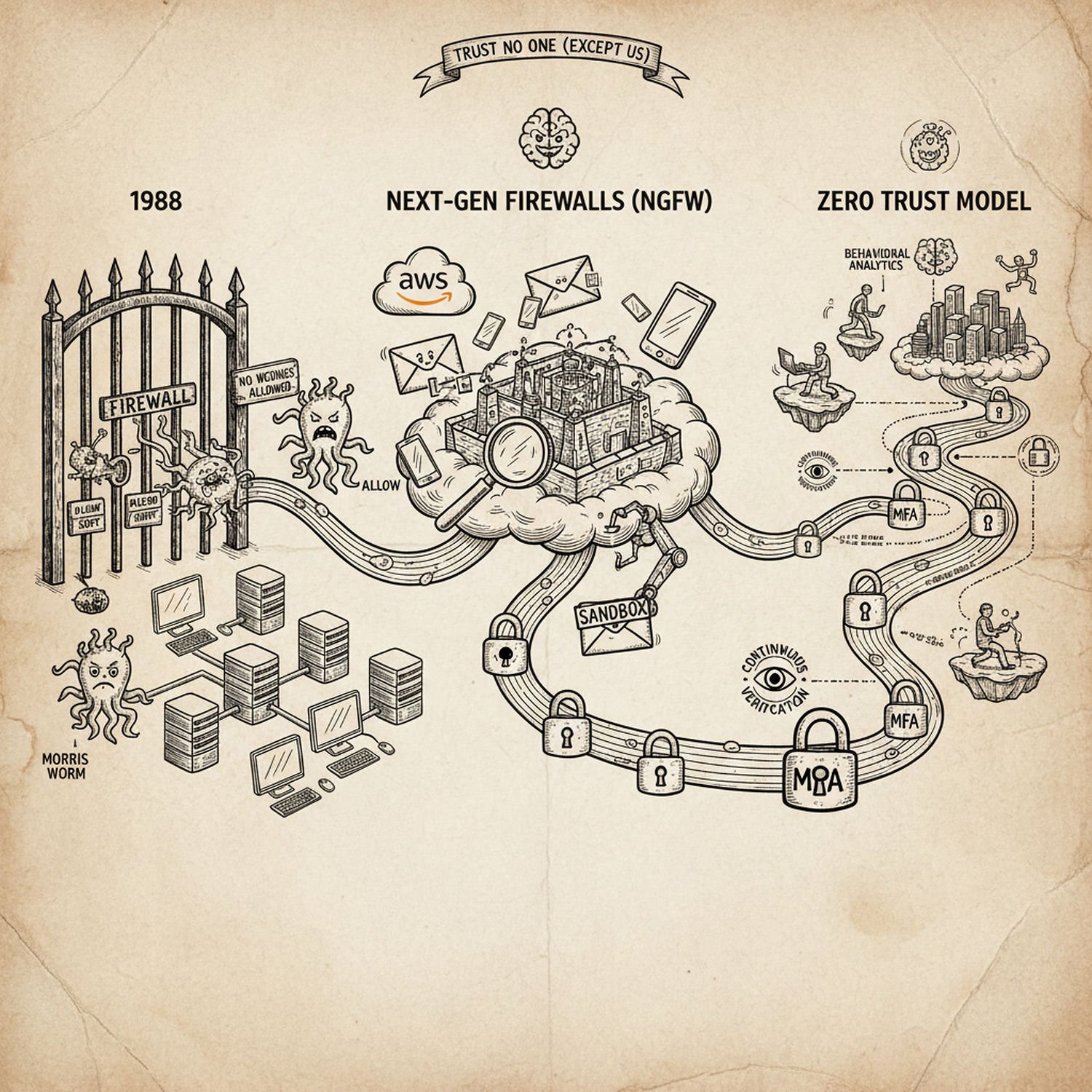

Pierwszy firewall pojawił się w 1988 roku, kiedy to inżynierowie z Digital Equipment Corporation i tym samym roku, gdy świat po raz pierwszy usłyszał o wirusie Morris, który zainfekował tysiące komputerów w sieci ARPANET. To wydarzenie stało się katalizatorem dla rozwoju narzędzi ochronnych. Koncepcja firewalla była prosta: działał jak strażnik przy bramie, filtrując ruch sieciowy na podstawie reguł, które zezwalały lub blokowały pakiety danych. W tamtych czasach sieć była statyczna, a zagrożenia ograniczały się głównie do zewnętrznych intruzów próbujących przedostać się do wewnętrznych systemów.

Podstawowy mechanizm firewalla opierał się na filtrowaniu pakietów (packet filtering), gdzie analizowano adresy IP, porty i protokoły, takie jak TCP czy UDP. Na przykład, jeśli reguła blokowała ruch z nieznanego adresu IP na porcie 80 (używanym dla HTTP), potencjalny atak mógł być zatrzymany w zarodku. Te wczesne urządzenia, często implementowane jako oprogramowanie na routerach, nie były idealne – nie radziły sobie z atakami na poziomie aplikacji ani z tunelowaniem ruchu przez VPN. Mimo to, stały się standardem w korporacyjnych sieciach, chroniąc przed prostymi skanowaniami portów czy próbami zalewania (flooding).

Z czasem, w latach 90., firewalle ewoluowały w kierunku inspekcji stanu połączeń (stateful inspection). To podejście, spopularyzowane przez firmę Check Point, śledziło cały cykl sesji sieciowej, pamiętając, czy połączenie zostało zainicjowane z wnętrza czy z zewnątrz sieci. Dzięki temu, odpowiedzi na zapytania były automatycznie dozwolone, co zwiększało efektywność bez utraty bezpieczeństwa. W erze dial-up i wczesnego internetu, takie mechanizmy zapobiegały wielu incydentom, ale z nadejściem chmury obliczeniowej w latach 2000., stały się niewystarczające. Tradycyjne firewalle zakładały zaufanie wewnątrz perymetru – raz wewnątrz sieci, użytkownik był uważany za bezpiecznego. To założenie, zwane modelem castle-and-moat, zaczęło pękać pod naporem zdalnego dostępu i mobilnych urządzeń.

Ewolucja zabezpieczeń – od perymetrycznych barier do warstwowej ochrony

Przejście do ery chmurowej, zapoczątkowane przez platformy jak AWS w 2006 roku, wymusiło redefinicję ochrony IT. Tradycyjne firewalle sprzętowe, ustawione na granicy sieci (network perimeter), nie mogły już efektywnie chronić rozproszonych środowisk, gdzie dane przechowywane są w chmurze publicznej, prywatnej czy hybrydowej. Ataki takie jak DDoS czy ransomware, jak ten z 2017 roku na Equifax, który naraził dane 147 milionów osób, pokazały słabości perymetrycznego modelu. W odpowiedzi powstały next-generation firewalls (NGFW), integrujące filtrowanie z zaawansowanymi funkcjami, takimi jak inspekcja głębokości pakietu (deep packet inspection, DPI), wykrywanie intruzji (intrusion detection system, IDS) i kontrola aplikacji.

NGFW analizują nie tylko nagłówki pakietów, ale i ich zawartość, blokując np. złośliwy kod w załącznikach e-mail czy nieautoryzowany transfer plików przez aplikacje chmurowe jak Dropbox. W chmurze, te urządzenia ewoluowały w cloud-native firewalls, wdrażane jako usługi (firewall-as-a-service, FWaaS), które skalują się dynamicznie z obciążeniem. Na przykład, w środowiskach AWS, firewall może być skonfigurowany za pomocą AWS Network Firewall, integrując się z innymi usługami jak VPC (Virtual Private Cloud), by chronić ruch między instancjami EC2.

Jednak nawet NGFW nie wystarczały w obliczu rosnącej liczby ataków insiderowych i phishingu, gdzie zagrożenie pochodzi z wnętrza. To doprowadziło do koncepcji zero-trust, która zakłada brak domyślnego zaufania – każdy dostęp musi być weryfikowany, niezależnie od lokalizacji. Model ten, spopularyzowany przez Forrester Research w 2010 roku, opiera się na trzech filarach: weryfikacja tożsamości, najmniejsze uprzywilejowanie (least privilege) i założenie naruszenia (assume breach). W erze chmurowej, gdzie pracownicy logują się zdalnie z dowolnego urządzenia, zero-trust staje się kluczowy dla bezpiecznego remote access.

Model zero-trust – ciągła weryfikacja w dynamicznym świecie chmury

Zero-trust to nie pojedyncze narzędzie, lecz architektura bezpieczeństwa, w której weryfikacja jest ciągła i kontekstowa. Zamiast polegać na statycznym perymetrze, system sprawdza użytkownika, urządzenie, aplikację i dane przy każdej interakcji. Na przykład, w scenariuszu zdalnego dostępu (remote access), pracownik próbujący wejść do firmowej chmury musi przejść wieloetapową autentykację (multi-factor authentication, MFA), a następnie system ocenia kontekst: czy urządzenie jest zaufane, czy lokalizacja jest bezpieczna, i czy zachowanie nie odbiega od normy (np. logowanie o nietypowej porze).

W chmurze, implementacja zero-trust obejmuje narzędzia jak zero-trust network access (ZTNA), które zastępują tradycyjne VPN-y. ZTNA, oferowane przez dostawców jak Zscaler czy Palo Alto Networks, tworzy mikro-tunelowanie tylko do konkretnych zasobów, bez otwierania całej sieci. To redukuje powierzchnię ataku (attack surface), uniemożliwiając lateralne przemieszczanie się hakerów po sieci po początkowym naruszeniu. Ciągła weryfikacja opiera się na analityce behawioralnej (user and entity behavior analytics, UEBA), która monitoruje anomalie, np. nietypowy transfer dużych ilości danych, i blokuje dostęp w czasie rzeczywistym.

W kontekście chmurowym, zero-trust integruje się z tożsamością jako usługą (identity as a service, IDaaS), jak Okta czy Azure AD, gdzie role są dynamicznie przypisywane na podstawie zasad (policy-based access). Dla firm, to oznacza przejście od reaktywnego gaszenia pożarów do proaktywnej ochrony. Badania Gartnera wskazują, że organizacje stosujące zero-trust redukują czas wykrywania naruszeń o 50%, co jest kluczowe w erze, gdy średni koszt breacha wynosi 4,45 miliona dolarów według IBM.

Korzyści zero-trust w erze chmurowej – redukcja naruszeń i ochrona kluczowych aktywów

Adopcja modelu zero-trust w środowiskach chmurowych znacząco zmniejsza ryzyko breachy, czyli naruszeń bezpieczeństwa. W tradycyjnym modelu, raz uzyskany dostęp do sieci pozwalał na swobodne poruszanie się, co ułatwiało ataki jak te w przypadku SolarWinds w 2020 roku. Zero-trust eliminuje to, wymuszając weryfikację na każdym kroku, co ogranicza rozprzestrzenianie się malware’u i minimalizuje straty. Dla remote access, gdzie 70% firm raportuje wzrost ataków phishingowych (według Verizon DBIR 2023), ciągła autentykacja zapobiega nieautoryzowanym logowaniom z niezaufanych sieci Wi-Fi.

Ochrona reputacji to kolejny filar korzyści. Naruszenie danych, jak w przypadku Yahoo w 2013-2014, gdzie ucierpiało 3 miliardy kont, prowadzi do utraty zaufania klientów i spadku wartości akcji nawet o 20%. Zero-trust buduje odporność, pokazując klientom i regulatorom (np. RODO w UE), że firma inwestuje w zaawansowane zabezpieczenia. Finansowo, redukcja breachy oszczędza miliony – nie tylko na remediacjach, ale i na uniknięciu kar (do 4% globalnego obrotu wg GDPR). W chmurze, gdzie skalowalność jest kluczowa, zero-trust umożliwia bezpieczny wzrost bez proporcjonalnego wzrostu ryzyka, integrując się z DevSecOps, gdzie bezpieczeństwo wbudowane jest w procesy CI/CD.

Podsumowując, ewolucja od firewalli z 1988 roku do zero-trust odzwierciedla zmianę paradygmatu: od obrony perymetru do ciągłej adaptacji. W erze chmurowej, gdzie hybrydowe modele pracy dominują, to podejście nie jest luksusem, lecz koniecznością, zapewniającą przetrwanie w cyfrowym krajobrazie pełnym zagrożeń. Firmy, które wdrożą te metody, nie tylko przetrwają, ale i zyskają przewagę konkurencyjną.

Informacja: Artykuł (w szczególności treści i obrazy) powstał w całości lub w części przy udziale sztucznej inteligencji (AI). Niektóre informacje mogą być niepełne lub nieścisłe oraz zawierać błędy i/lub przekłamania. Publikowane treści mają charakter wyłącznie informacyjny i nie stanowią porady w szczególności porady prawnej, medycznej ani finansowej. Artykuły sponsorowane i gościnne są przygotowywane przez zewnętrznych autorów i partnerów. Redakcja nie ponosi odpowiedzialności za aktualność, poprawność ani skutki zastosowania się do przedstawionych informacji. W przypadku decyzji dotyczących zdrowia, prawa lub finansów należy skonsultować się z odpowiednim specjalistą.

Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: Traditional detailed engraving illustration with modern elements, etched lines, high contrast black and white, meticulous cross-hatching to create depth, printed on aged parchment paper of: A visual timeline illustrating the evolution of IT security: on the left, a 1988-era firewall depicted as a sturdy gate blocking external network threats like a virus icon from the Morris worm era, with simple packet filtering rules shown as filters on data packets flowing into a static network; in the center, next-generation firewalls (NGFW) as layered barriers with deep packet inspection tools scanning email attachments and app traffic in a hybrid cloud environment including AWS icons and mobile devices; on the right, a zero-trust model in a dynamic cloud landscape with continuous verification checkpoints, multi-factor authentication locks on every access point, behavioral analytics monitoring user anomalies, and secure micro-tunnels connecting remote workers to specific resources without perimeter trust, all connected by a flowing river of data packets symbolizing protected information flow. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist. Illustration: copperplate etching texture, ink lines, dramatic shading, artistic style, deep focus, museum quality print with humorous twist.

Polecamy: Technologie IT – od liczydła do komputerów